鄢凯杰 孙 略

北京电影学院影视技术系,北京100088

1 引言

分镜头脚本作为电影摄制前期的重要环节,是将文字化的剧本转换为图像化视觉呈现的过程,为整部影片提供视觉上的预览。分镜头脚本作为编导部门与摄制部门沟通的重要桥梁,可以协调统一整个影片的视觉风格以及影像创作手法。随着人工智能(AI)的发展与变革,自2022 年出现了以Midjourney、Stable Diffusion 为代表的图像生成工具,并在图像生成领域取得了突飞猛进的进展。这些AI图像生成工具有着很强的美术竞争力,甚至掀起了关于“AI 是否会替代画家的讨论”[1]。随着电影数字化和虚拟化的发展,人工智能生成内容(AIGC)作为一项结合自然语言处理(NLP)和计算机视觉(CV)的新兴技术,在电影制作及其相关产业领域表现出很大的应用潜力[2][3]。

本文介绍了当前AI 在图像生成领域的应用,并对目前业界分镜头绘制方式的优缺点进行了对比探究,通过对AI 辅助分镜头脚本绘制方面的可行性进行分析,结合三维软件Houdini 和图像生成工具Stable Diffusion,提供一种便于人为控制、用于实际绘制电影分镜头脚本的方式。

2 当前AIGC 在图像生成领域的应用

2.1 图像生成与编辑

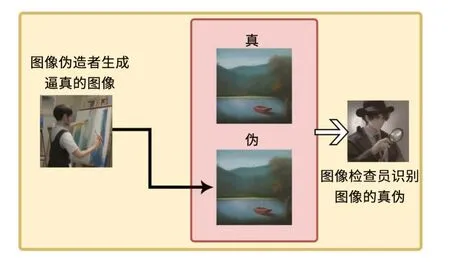

AIGC 可以帮助用户快速生成图像或对现有图像进行修改。结合生成式对抗网络(GAN)技术[4],通过输入随机噪声,同时训练生成器与判别器两个模型,生成输出来自训练集分布的样本,通过艺术伪造者和艺术检察员的比喻,可以更直观地了解GAN 概念[5](图1)。此外,AIGC 也可以生成不同风格的图像,或者将不同图像元素合成在一起,创造出令人惊叹的画面或虚拟场景。

图1 通过艺术伪造者和艺术检查员了解GAN 概念

如在训练过程中,Midjourney 通过使用大量的图像和文本样本进行训练,可以将文本转化为视觉元素。只要用户输入相应的文本提示,Midjourney 就可以根据训练结果生成相应的视觉效果[6]。这些文本元素可以是任何内容,如对场景、物体或人的外貌描述等。在生成过程中,Midjourney 不仅需要掌握生成逼真图像的能力,还需要学习根据用户提供的文本生成相应的图像内容。同时,Midjourney 将文本数据与对应的图像进行配对,并将其作为条件信息输入到GAN 模型中。之后GAN 能够利用这些条件信息,限制生成与文本数据相符的图像,以实现文本到图像的转化[7]。

2.2 图像风格转换

迁移学习(Transfer Learning)是一种利用预训练模型生成图像的方式,用户通过对大数据的预训练模型进行训练,利用深度学习(DL)模型使图像拥有特定的艺术风格或特征。换言之,AI 能够将一幅图像的风格转换成另一幅图像的风格,以Stable Diffusion 的风格迁移为例,其通过参考图输入,控制提示词(Prompt)生成图像,从而创建出独特的视觉效果,可以广泛应用于艺术创作、电影后期制作以及图像编辑工具中,使用户能够将不同艺术风格应用于图像生成[8]。

2.3 自动化创意设计

在艺术设计领域,AIGC 可以根据设计师意图,协助生成如LOGO、海报、产品的外包装等创意元素,也可根据需求进行输入,自动生成多种设计选项,为创意工作提供灵感,还可通过分析大量创意数据与趋势,为设计师的创作提供方向和建议,在短时间内生成大量相关内容,减少构思与创作的时间和精力,大幅提高生产效率,更好地满足受众的需求[9]。

2.4 图像修复功能

在高效解决图像修复方面,AIGC 可以修复图像中损坏或缺失的部分,例如修复老照片的撕裂、折痕或褪色部分;移除原照片中不需要的物体,消除噪点、鬼影,增强图像的分辨率、细节和调整色调。

3 当前绘制分镜的方式

分镜头脚本的绘制是电影摄制过程中的关键步骤之一,它可以帮助导演和制片人将剧本中的场景可视化,以便更好地理解拍摄内容和沟通拍摄计划。随着技术和工具的不断迭代,电影场景的分镜头脚本绘制方式也逐渐多样化[10]。

3.1 手绘分镜

手绘分镜是传统分镜绘制方式之一,目前依然在电影制作中广泛使用,它通常由分镜师以草图或详细的画面手工绘制,用于传达场景构图、摄影角度、角色动作和对话等信息。

3.2 数字绘制分镜

随着计算机技术和数字技术的发展,许多分镜师转向了如平板电脑、数位板和分镜软件等数字绘图工具。这些工具使分镜师能够在电脑上绘制、编辑和共享分镜,从而更快速和灵活地进行创作。数字绘图还允许添加动画和过渡效果,以更好地模拟电影的动态性。例如WonderUnit 电影工作室发布的软件Storyboarder,内置6 种直观的绘图工具,允许用户输入对话、动作、定时信息以及拍摄类型等内容,可以迅速、轻松地制作分镜头脚本。

3.3 3D 建模和渲染

3D 建模和渲染技术的诞生与发展,使分镜头脚本绘制更加逼真和精确。分镜师可以使用3D 建模软件创建场景和角色,并使用渲染引擎生成高质量图像,这些图像在应用于分镜时可以提供更准确的摄影视角和特效。Maya、C4D、Houdini、UE 等常用3D软件,虽然在三维建模、镜头运动设置以及渲染生成等方面已经十分成熟且易用,但通过使用3D 建模渲染生成分镜头脚本画面的方式,有着较高的使用门槛以及学习时间成本。

其他常见的绘制分镜的方式还有视频分镜、虚拟现实分镜以及电影制片公司出品的在线分镜绘制平台和协作工具等,如以Shot Designer 为代表的机位图软件。

3.4 当前分镜绘制方式的局限性

(1)创意的枯竭

在构思电影画面的过程中,电影创作者所面临的最为困难的挑战之一就是创意枯竭。有时电影创作者们需要在自己的素材库中不断搜寻创意灵感,但是要在成百上千部电影和图片素材中找到与他们的创意完美契合的素材并非易事[11]。

(2)受创作者的画功水平限制

对于不擅长绘画的导演来说,创建生动的分镜头画面或图像可能会成为一项艰巨任务。为了提升分镜头的视觉效果,电影创作者需要查找海量的参考图片,这需要耗费大量时间和精力。特别是在小预算的项目中,很少有足够的资源雇佣美术人员来支持这一工作,因此在找到合适的“参考图片”方面可能会变得尤为繁琐[12]。

(3)逻辑排序修改繁琐

分镜头脚本中的分镜逻辑排序是一个复杂的问题。有时,线性叙事通常会显得过于平淡,因此导演通常会采用非线性的逻辑剪辑思路,通过不断调整镜头之间的逻辑关系以达到想要表达的叙事效果。然而,目前的处理方式通常是在类似Excel 的软件中手动进行前后分镜头的替换,不断插入新的行并复制粘贴,十分繁琐且容易出错[13][14]。

(4)现有的分镜软件缺陷明显

如上文所述,许多分镜软件具有复杂的用户界面和功能,对新用户来说,需要一定时间来熟悉软件操作,且大多数分镜软件缺乏智能辅助,无法自动化处理一些繁重和重复的任务。一些高级的分镜软件则需要高额的许可费用,这对小预算项目构成负担。此外,分镜软件通常需要强大的计算机硬件支持,特别是在处理复杂的3D 动画和渲染时。

(5)成本问题

无论是采用传统手绘分镜或数字绘图,分镜师需要花费大量时间来绘制每个场景的分镜,尤其是在大规模电影制作中,需要大量的人力资源和时间成本[15]。

总体来看,上述问题都反映出目前分镜头脚本的制作方式仍不够智能,存在工作效率低下、成本难以控制等问题。因此,笔者认为大胆地探索应用AI技术,可以显着提高分镜头脚本绘制的效率,甚至有望实现自动生成分镜头脚本的目标。

4 人工智能赋能分镜绘制

AI 技术的崛起为分镜头脚本的创作带来了新机遇,如可以根据剧本和场景要求的文字内容自动生成初步的分镜草图,为分镜师提供灵感和参考;AI 辅助绘制分镜头脚本可以提高效率,降低制作成本,并为制作人员提供更多的创作自由。

4.1 AI辅助绘制分镜头方式

4.1.1 利用AIGC 图像生成工具绘制分镜

以Midjourney 和Stable Diffusion 为代表的图像生成工具已开始在分镜绘制中发挥作用。用户通过输入画面要求的文字提示,生成与画面要求相近的AI图片,笔者以Midjourney 和Stable Diffusion 为例,进行了分镜头脚本生成的系列测试。

(1)角色测试

笔者的第一个测试是在Midjourney 中创建一个角色,并使用产生的图像作为新框架的参考,生成一组分镜头脚本。笔者在Midjourney 输入限定词生成了一个中国古代少年侠客的形象,将其作为下一个分镜头脚本框架的参考。

我们首先尝试使用Midjourney 的局部重绘(Region)功能,将生成的角色置于不同场景中,例如山间小路、亭台楼阁以及手持兵器的场景(图2)。从结果可得出,使用这种方法后的角色在所有画面中都保持了相似外貌,看起来像同一角色。然而,这一方法几乎不具备改变角色整体构图的能力。最终输出的结果将最初图像作为了重要参考,尽管将角色的提示词放在提示序列的最后,生成的角色仍然处于相同的构图和位置。因此,这次使用Midjourney 控制单一角色生成分镜头脚本的测试是失败的。

图2 将生成的角色形象置于不同的背景场景中

(2)故事板测试

故事板是一种精确的分镜头脚本,包括取景、物体移动、摄影机移动等。笔者通过对Midjourney 输入画出推、拉、摇、移、变焦等,均没有成功。

(3)根据设计师手稿绘制动画分镜

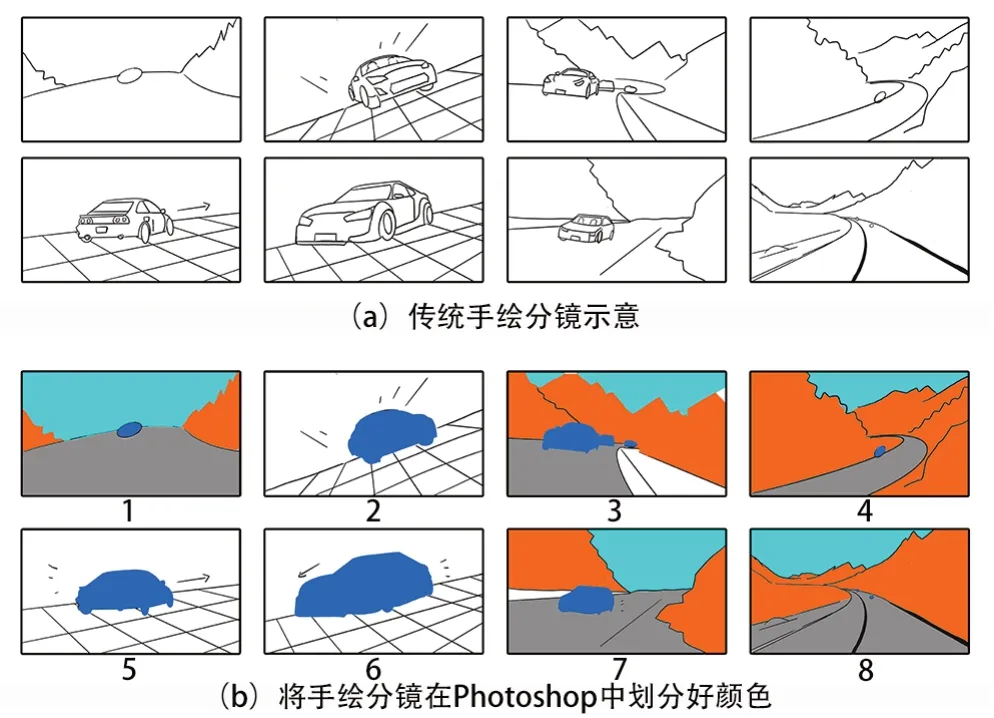

测试使用Stable Diffusion 中ControlNet 插件的语义分割(Seg)功能和线稿(Canny)功能,对手绘分镜手稿进行上色和优化。首先,笔者手绘了一组简略分镜头脚本〔图3(a)〕。之后通过ADE20K 的Seg 语义参考表格获取色值信息,以手绘线稿图3(b)中的第7 张图为例,在Photoshop 中划分颜色告诉Stable Diffusion 此区域需要识别为哪种物体,其中车为#0066C8,道路为#8C8C8C,山丘为#FF6600。将划分好颜色的区域添加到ControlNet 中,使用语义分割功能进行预处理。添加好描述词后利用Stable Diffusion 进行生成〔图4(a)〕。以手绘线稿图3(b)中的第2 张图为例,使用线稿模式,将手绘线稿导入Stable Diffusion,输入描述词后进行上色、优化输出〔图4(b)〕。

图3 手绘分镜测试

图4 在Stable Diffusion 中对手绘分镜进行处理

最后,使用Stable Diffusion 按上述步骤进行生成,输出可以让需求方更加直观感受画面效果的分镜头脚本(图5)。由生成的效果图可直观地看到,使用Stable Diffusion 将手绘稿进行上色、优化输出的方式存在着严重的主体认知模糊问题。

图5 在Stable Diffusion 中将手绘稿进行上色、优化输出的结果

4.1.2 利用AI在线分镜头脚本生成器制作分镜

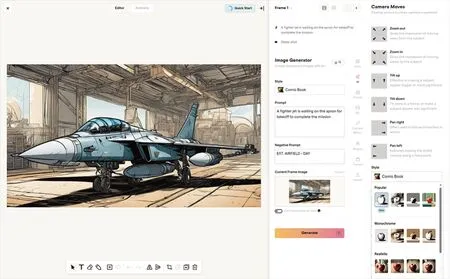

(1)Boords

Boords 是由英国动画工作室Animade 开发的一款操作简单、功能实用的在线分镜头脚本生成器。笔者使用ChatGPT 生成一个关于空战主题的电影剧本《Aces of the Skies: Wings of Destiny》,选定生成风格后自动生成分镜头脚本(图6)。同时,作为一个在线编辑平台,Boords 提供了大量协作工具,既方便团队协作,操作也相对简单(图7)。其明显缺点在于可使用的风格较少,镜头间连贯性不足,画面可控性低。

图6 在线分镜头脚本生成器Boords生成方式

图7 Boords内置的摄影机移动、画面风格等编辑和协作工具

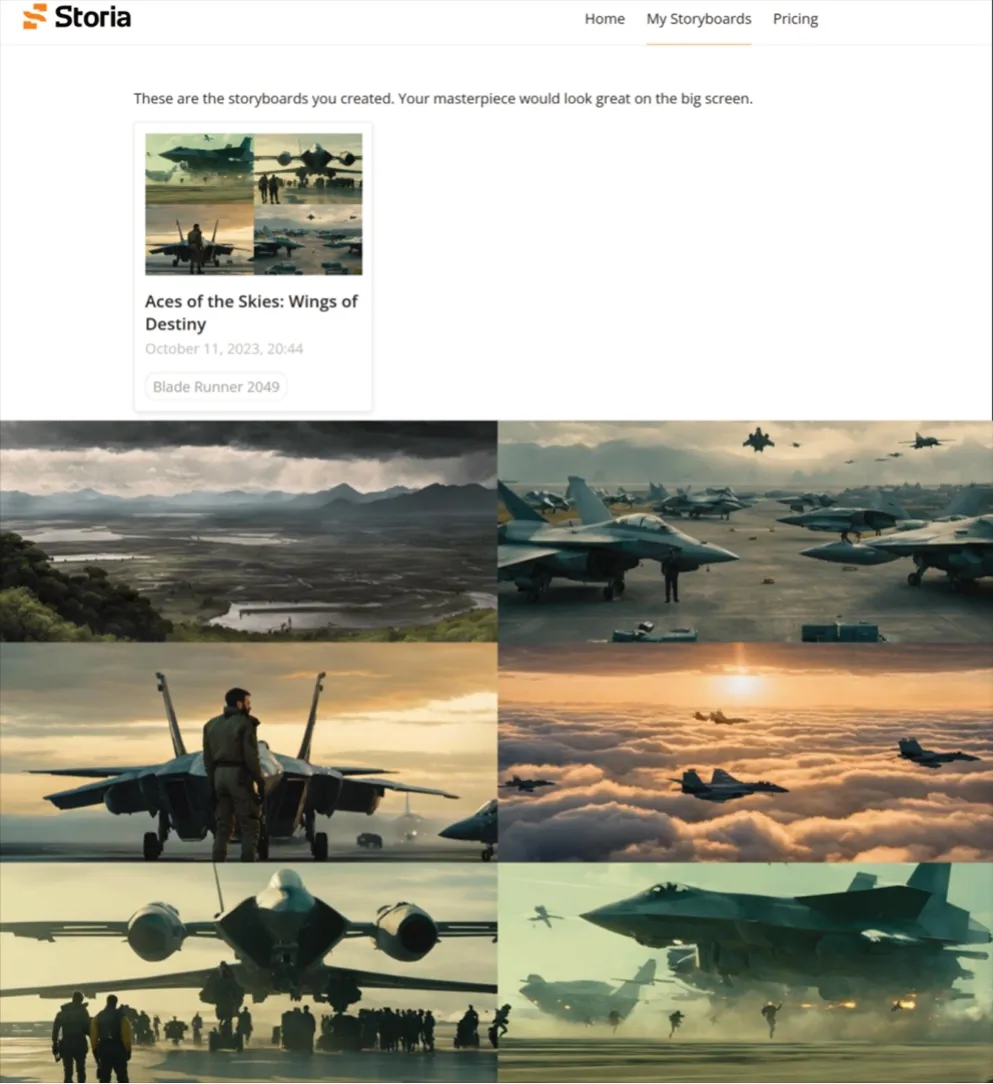

(2)Storia

在线分镜头脚本生成器Storia 通过输入剧本文本、剧情场景、关键人物字符、选择喜爱的风格实现分镜头脚本的自动生成。笔者继续使用空战主题剧本《Aces of the Skies: Wings of Destiny》,将该剧本输入到Storia 的Script 选项,并选择《银翼杀手2049》风格进行测试。由输出结果可见(图8),Storia 界面简洁,用户根据文字提示就能快速掌握。在功能性和创新性方面,就笔者测试结果而言,其本质就是文本生成图像(Text-To-Image),用户编写一句提示词且选中风格后,平台自动生成相应的图片。图像生成的AI 引擎目前只能使用Stable Diffusion,同时生成的图像也存在主体认知模糊的通病。

图8 在线分镜头脚本生成器Storia 测试结果

综上所述,选用Boords、Storia 等AI 在线分镜头脚本生成器制作电影分镜的结果并不理想。

4.2 目前AI辅助绘制分镜方式存在的问题

(1)技术与创意限制

目前的AI 技术仍然存在一些限制,特别是在生成复杂度高、创新性强的图像方面,尚不能完全替代创作者的创造力。当前的AI生成内容通常是基于训练数据生成分镜头脚本,其创作能力受到训练数据的限制,因此AI 可能会倾向于生成与训练数据相似的内容,难以提供新颖或具有突破性的创意[16]。

(2)情感表达与逻辑错误

分镜头脚本通常需要给演员传达角色的情感,以方便演员的表演。AI 在这方面的表现有限,由于难以捕捉和表达情感,可能导致其生成的分镜头脚本缺乏情感深度。在理解和维护逻辑一致性方面,AI也存在不足,需要通过人工干预进行修复[17]。

(3)主体认知模糊与内容理解模糊

AI 系统需要大量的训练数据和不断地迭代,以保持提供准确的结果。现阶段的AI生成图像技术存在主体认知模糊问题,如经常出现人物手指缺失以及不能完全按照要求理解创作者想法的情况,需要更多时间来适应创作者的特定需求与风格。虽然技术在不断更新迭代,但是AI 仍然面临理解和解释自然语言(NL)的挑战,生成准确的分镜头脚本需基于对剧本、故事情节、角色、对话和情感的深刻理解,这对于AI来说仍然是复杂且难以处理的任务[18]。

(4)人工审查与修改

目前使用AI协助制作的分镜头脚本仍然需要人工审查和修改以确保质量。同时要审查是否存在伦理问题、敏感内容等[19]。尽管AI 可以生成分镜头脚本的初步草稿,但在大多数情况下,专业导演仍然需要审查和修改这些草稿,以确保它们符合其视觉愿景和创意要求。这在一定程度上增加了制作时间和成本[20][21]。

4.3 基于Houdini 的AI 图像生成工具Stable Houdini

Stable Houdini 是俄罗斯开发者Stanislav Demchenko 开发的一套基于Stable Diffusion WebUI 的Houdini 数字资产(Houdini Digital Assets, HDA),是一个将Stable Diffusion 集成到Houdini 中的开源工具包。该工具已用于虚拟摄制公司EVR-Systems 的项目,还被Houdini 官网予以推荐。通过在窗口生成深度图(Depth)HDA 并配合ControlNet 生成更加定制化的图像,该工具可以很好地解决AI 生成图像的主体认知模糊问题[22]。

在使用方面,Stable Houdini 有以下功能:(1)可以从Houdini 内部控制生成的人工智能,根据文本提示、源图像或3D 场景的组成生成2D 图像;(2)该工具基于Automatic1111 api,可以提升Stable Diffusion生成图像的分辨率,使用ControlNet 扩展控制Stable Diffusion,创建简单的动画、视频,以及基于图像生成法线或深度图;(3)可以在本地运行,使用便捷。因此,我们将使用Stable Houdini 进行分镜头脚本生成的测试。

4.3.1 测试实施

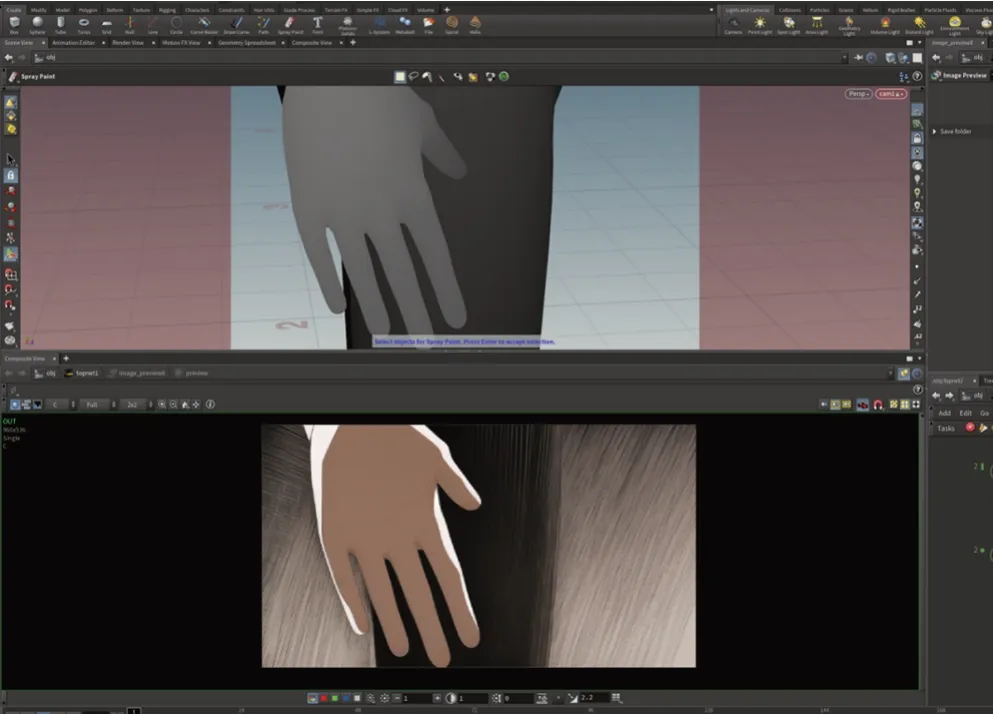

(1)主体认知模糊问题

笔者在Houdini 中,创建Stable Houdini 节点,导入3D 人物模型资产,在Stable Diffusion 节点中添加模型风格,输入提示词和限定词,测试生成人物图像的细节方面是否存在不完整的情况。通过控制Houdini 中虚拟摄影机的焦距、物距控制画面构图,测试结果表明生成的人物手部细节均未出现关节缺失、肢体增加的情况(图9)。

图9 控制Houdini中虚拟摄影机的焦距测试生成人物图像的细节

(2)同一资产生成不同风格画面

笔者尝试在Houdini 中使用同一角色数字资产创建不同风格画面,虚拟摄影机的焦距、物距和景别保持一致,通过在Stable Diffusion 节点中改变输入提示词、限定词和模型风格的方式,得到如下结果:可以使用同一数字资产为主体在Stable Diffusion 中生成不同风格画面,且焦距、物距和景别保持一致(图10)。

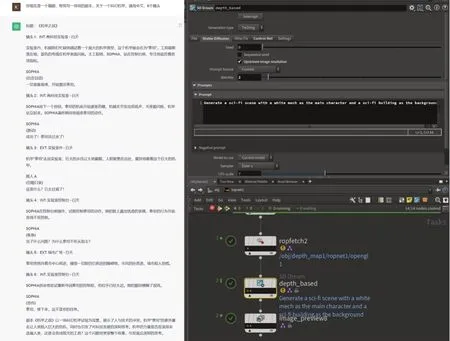

(3)根据剧本输入提示词生成分镜头脚本

笔者尝试在ChatGPT 中生成有关机甲未来风格的剧本,并在Houdini 中创建相应3D 场景,通过控制虚拟摄影机的焦距、物距和景别,通过在Stable Diffusion 节点中根据ChatGPT 生成的剧本控制输入提示词、限定词和模型风格的方式(图11),尝试生成有连续镜头的故事片分镜头脚本。

图11 在Stable Diffusion 中根据剧本控制输入提示词

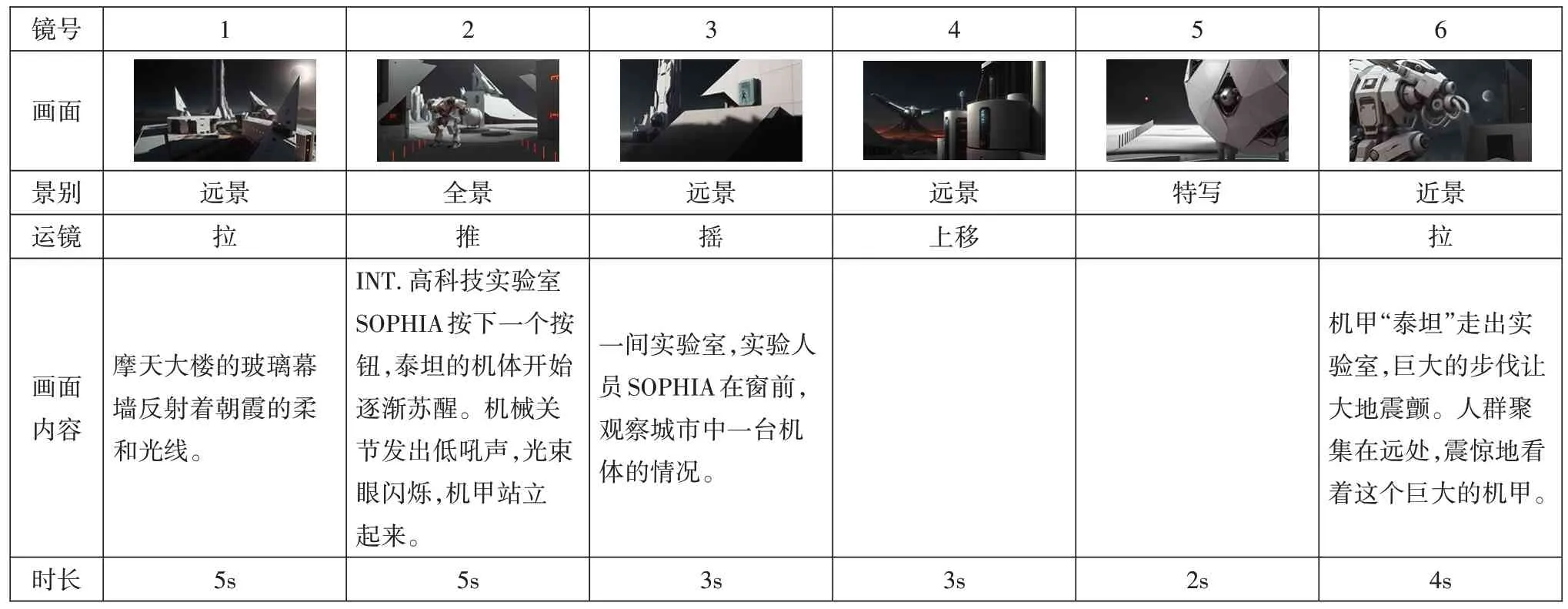

由测试结果可见,通过在Houdini 中改变虚拟摄影机的位置,在相同的Stable Diffusion 模型控制下,可以按照创作者的景别、透视要求,生成相同风格的组图。根据创作者所需镜头语言生成相应画面,作为分镜头脚本使用(表1)。

表1 生成结果作为分镜头脚本使用

4.3.2 测试结论

Stable Houdini 在生成分镜头脚本方面具有独特的优势:(1)如避免生成特写画面时主体认知模糊,出现细节识别不准确的情况;(2)能够实现不改变构图情况下快速改变画面风格,生成画面风格可控;(3)便于用户精确地把控画面景别、透视等。但Stable Houdini 在使用上也有一定局限性:首先,该工具包基于本地机器离线运行,对于硬件配置要求较高;其次,在配置使用环境方面,步骤较为复杂;此外,Houdini 和Stable Diffusion 的使用具备一定技术门槛,需要较高的学习成本,对于初学者并不是很友好。

总得来说,Stable Houdini 是目前少有的可以使用3D 模型来指导AI 生成图像的工具。笔者认为,在具备一定软件操作基础的影视创作者手中,Stable Houdini 将是一款高效的分镜头脚本生成工具,其应用范围甚至可以拓展到创建数字资产、概念艺术、电影视效镜头等方面。

5 思考与展望

作为导演表达创作意图的重要手段,分镜头脚本既有利于主创团队各部门的协同,也是重要的视觉传达工具。相比于文字脚本以及人物与空间的透视关系,笔者认为分镜头脚本的核心更注重表达准确的构图,以便将所需镜头语言、创作意图准确传递给分镜师。

尽管使用人工智能创建分镜头脚本有其局限性,且这一生成方式与传统人工绘制方式存在较大差异,尤其是在创建基于一致角色的分镜头脚本或故事板时,情况更是如此,因此,人工智能在短期内尚无法取代分镜头脚本艺术家。然而,在其他情况下,AIGC 可以产生更为广泛的想法和草图,快速探索更多创意选项,尽快找到正确概念,这在一定程度上加快了创作进程。未来,随着技术的持续发展,我们可以期待看到更多创新的分镜头脚本绘制方式。可以预见的是,人工智能将在未来深刻改变电影行业,从图像、剧本、声音到动画,多种资源都可以借助AIGC 降本增效。作为电影行业从业者,我们在积极探索新技术应用前景的同时,也要谨慎考虑各种新技术发展所带来的风险和挑战,在充分发挥其优势的基础上,共同推动电影行业的繁荣。❖